ChatGPT teamの運用を続ける中で見えてきた『業務フローへの適用しづらさ』や『コスト増』という課題を解消するため、AWS上にDifyを構築し、ノーコードで生成AIアプリを運用する方法に切り替えました。本記事では、移行背景や具体的なアプリ事例、コスト比較、セキュリティ対策などをご紹介します。

重要ポイントをサクッと確認

全社導入から見えた、ChatGPT活用の真の壁

ディーネットでは2024年2月より、「ChatGPT team」のアカウントを全社員に発行し、業務効率化を進めてきました。teamプランを利用することで学習データとして外部に流用されるリスクを抑え、セキュアに生成AIの活用が可能でした。

さらに、社内の定期勉強会や業務改善コンテストも積極的に開催し、社員のAIリテラシーを向上。壁打ちやアイデア出し、商談ロールプレイ、文章レビューなど、個人レベルでの活用が大いに促進されました。

これらの取り組みはアンケート結果にも表れています。導入から12か月後の調査では、

- 約6割のメンバーが毎日利用

- 週に数回以上利用する人を含めると9割を超える

- 7割近いメンバーが生成AIの利用に満足

という高い評価を得られました。

ところが、使い込むほどに明らかになった課題が「業務フローへの適用のしづらさ」です。特定のプロンプトを社内で共有・標準化する手間や、GPTsの出力の不安定さなどが要因で、「日々の業務フローに自然に組み込む」のは意外と難しいという声が目立ちました。

個人での業務利用は浸透したものの、チームとして業務フローの一部として組み込むことが難しい、という課題を抱えたのです。

AWS×Difyという選択:なぜChatGPTから移行したのか

そこで、「チャット活用」のメリットを維持しつつ業務フローへ組み込みやすい方法を検討した結果、AWS上にDifyを構築する運用に行き着きました。

Difyは、ノーコードで生成AIアプリケーションを利用できるプラットフォームです。たとえばChatGPTやGPTsのようなチャットアプリだけでなく、所定の作業手順とLLM(大規模言語モデル)を組み合わせて作業を自動化・完了させるワークフローも自作できます。

SaaS版のほかにコミュニティ版(セルフホスト)が提供されており、AWS環境上に独自構築することで、自社管理のセキュア環境+LLM API連携を両立することができます。

全社共通と個別開発:使い分けるDifyアプリケーション戦略

ディーネットではDify上に「全社共通アプリケーション」と「個別アプリケーション」の2軸で展開をしています。

全社共通アプリケーション

ChatGPTのような汎用的なチャットアプリケーション作成して全社公開しています。

LLMとしては、Amazon Bedrock経由のClaudeまたは、OpenAIのChatGPTなど、汎用的な最新のものを適用しています。また、チャットアプリケーションにツールを追加することができます。それを利用し、Google検索やPerprexity、Dall-E3などが入力されたプロンプトに応じて自動で呼び出して対話を拡張できるように仕組みを整えています。

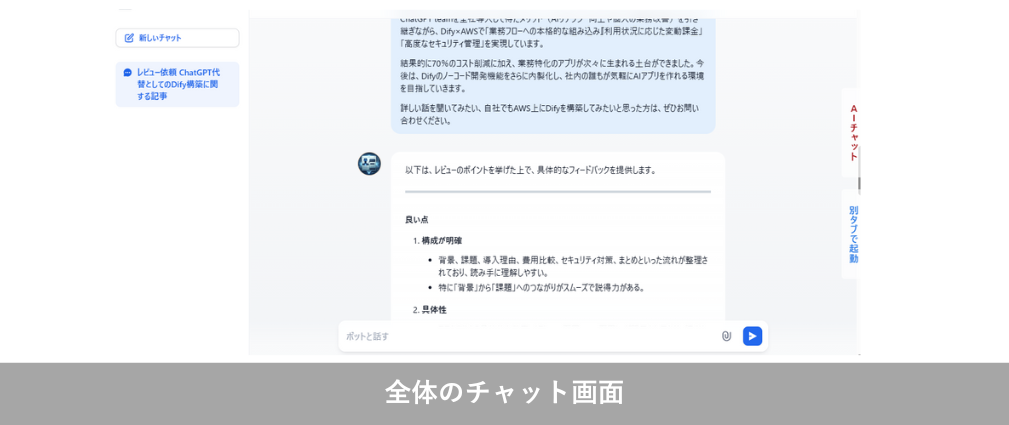

また、Chromeなどのブラウザの拡張機能を利用し、チャットアプリケーションへアクセスしやすい環境を実現しています。(下の図の右端にある「AIチャット」「別タブで起動」部分が該当します)

個別アプリケーション

一方、各部門・メンバー独自の目的にあったアプリケーションを、ノーコードベースで自由に作成できる仕組みも用意しています。ただし、現状はハードルがやや高いようで、得意なメンバーが要望をヒアリングしながら実装するケースが多い状況です。今後、ドキュメントやテンプレートを整え、より多くのメンバーが手軽に開発できるよう支援していきます。

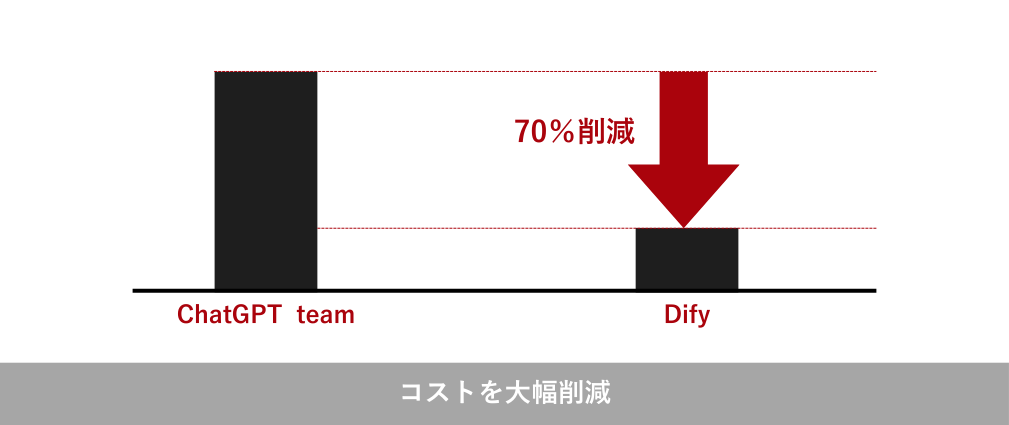

驚異のコスト削減率70%!その内訳を公開

従来のChatGPT teamプランでは、利用の有無にかかわらず社員の人数分の固定料金が発生していました。たとえば、

- 1アカウント月額30ドル(年契約時は25ドル)

- 60アカウント利用で 25ドル×60名=1,500ドル

- 1ドル150円換算で合計約22万円/月

この費用が大きな負担となっていたのです。そこでDify環境への移行を進めたところ、次のような支出構造になりました。

- AWSの利用料:1.5万円(EC2などのほぼ固定料金)

- LLM APIの利用料:4万円(使った分だけ従量課金)

合計は約5.5万円となり、従来の22万円から70%以上のコスト削減を達成。これは全社員がAPI連携のサービスを使う形にシフトしたことで、実際の使用状況に応じた変動費用になったのが大きな要因です。

AWS Bedrock×Difyの実装手順:誰でもできるAI基盤の作り方

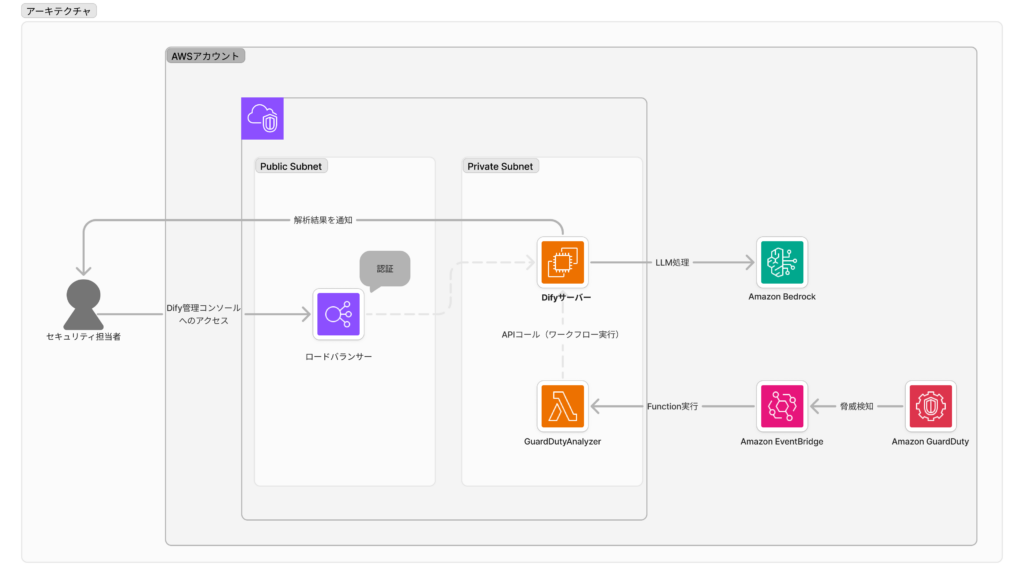

ディーネットでは、主にAWS公式が公開している「Dify と Amazon Bedrock を使って、簡単にセキュリティオペレーション自動化」の手順を参考にしました。記事内の「1. 完成図」~「3. Dify の設定とワークフロー構築」などを参照すると、概念図や具体的なアーキテクチャが理解しやすいです。

社内情報を守りながらAIを活用:4つのセキュリティ施策

生成AIアプリを運用するうえで重要なのが、機密情報をどのように守るかという点です。ディーネットでは、以下の対策を講じています。

- Webアプリケーションは社内のみアクセス許可

- インターネットからのアクセスは遮断し、事務所からのみアクセスを許可。

- テレワーク環境からは、事務所へVPN接続を行うことで、利用可能に。

- APIのみに社外アクセスを許可

- AWS Lambdaや他システムからのAPI呼び出しに限り、外部からの接続を許可。

- Difyが持つAPIキー認証を利用しセキュリティを担保。

- LLMとのやり取りはAPIを通じて実施

- ChatGPT teamと同様、学習データに使われない仕組みを確保。

- アプリケーションの利用ログの閲覧制限

- 「ログを見られたくない」という要望に対応し、ALBを使ってログ閲覧を抑止。社員がユーザーの入力データを閲覧できない運用設計に。

これらの取り組みによって、「個々の利用状況を見られたくない」 という不安を払拭し、生成AIアプリの利便性と安全性を両立させています。

ChatGPTの学びを活かし、Difyで進化:自社AI基盤の未来図

ChatGPT teamを全社導入して得たメリット(AIリテラシー向上や個人の業務改善)を引き継ぎながら、Dify×AWSで「業務フローへの本格的な組み込み」「利用状況に応じた変動課金」「高度なセキュリティ管理」を実現しています。

結果的に70%のコスト削減に加え、業務特化のアプリが次々に生まれる土台ができました。今後は、Difyのノーコード開発機能をさらに内製化し、社内の誰もが気軽にAIアプリを作れる環境を目指していきます。

あなたの会社でも実現可能!AWS Dify導入の第一歩

「自社でもChatGPT teamに代わるAIプラットフォームを検討したい」「AWS上でDifyを構築して業務効率化を進めたい」などのご相談がございましたら、ぜひ以下からお気軽にお問い合わせください。

弊社のエンジニアが、具体的な導入方法・コスト試算・セキュリティ要件の検討など、丁寧にサポートいたします。